Обзор

GitHub Models обеспечивает простой рабочий процесс оценки, который помогает разработчикам сравнивать крупные языковые модели (LLM), уточнять запросы и принимать решения на основе данных внутри GitHub платформы. Вы можете экспериментировать GitHub Models с новыми функциями или проверять изменения моделей, анализируя производительность, точность и стоимость с помощью инструментов структурированной оценки.

Совет

Вы можете выполнять оценки непосредственно из командной gh models eval строки с помощью команды. Он использует те же вычислители, что и пользовательский интерфейс: соответствие строк, сходство, пользовательские вычислители LLM как судьи и многое другое, чтобы вы могли протестировать .prompt.yml файл локально или в CI.

Сценарии использования GitHub Models

Поведение модели может значительно отличаться в зависимости от запроса, ввода или конфигурации. GitHub Models Помогает вам:

- Тестирование и сравнение нескольких LLM в реалистичных вариантах использования.

- Оптимизация фраз запроса, температуры и других параметров.

- Оцените выходные данные модели с помощью структурированных, повторяемых метрик.

- Интеграция разработки ИИ в рабочий процесс разработки.

Пример сценария

Рассмотрим сценарий, в котором вы создаете функцию для сводки отзывов клиентов, отправленных через запросы в службу поддержки. Эти сводки будут использоваться для создания внутренних отчетов и билетов, поэтому выходные данные должны быть четкими, соответствующими и краткими.

Требуется

- Экспериментируйте с различными моделями и конфигурациями запросов.

- Оцените оптимальную конфигурацию на основе качества, согласованности и эффективности.

- Сохраните конфигурацию в репозитории для повторного использования и совместной работы.

Тестирование запросов на игровой площадке

Чтобы ознакомиться с тем, как создавать и управлять подсказками в GitHub Models, см. раздел «Тестирование подсказки в игровой площадке».

Платформа позволяет сравнивать модели параллельно, настраивать их параметры и тестировать варианты запроса.

На этом шаге вы настроите модель для создания сводок для отзывов о поддержке клиентов. Вы определите системный запрос, протестируйте его с помощью примера входных данных и измените его, чтобы убедиться, что выходные данные являются краткими и релевантными.

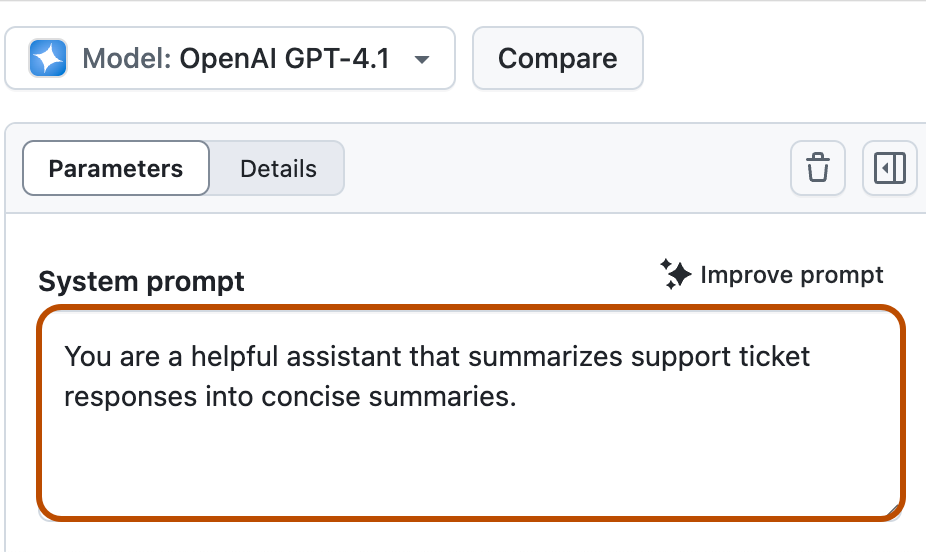

Определение системного запроса

Определите поведение модели для текущей цели. В этом случае цель заключается в обобщении отзывов клиентов. В разделе "Параметры" введите следующую системную строку:

You are a helpful assistant that summarizes support ticket responses into concise summaries.

Оставьте оставшиеся параметры заданными по умолчанию.

Написание запроса пользователя

Теперь, когда модель настроена, в диалоговом окне "Запрос " введите следующие отзывы клиентов:

The app crashes every time I try to upload a PDF from my phone. It works on desktop but not on mobile.

Модель может создать ответ следующим образом:

The user experiences consistent app crashes when attempting to upload a PDF from their phone. Uploading PDFs works normally on desktop. They request an investigation into the issue.

Использование переменных в запросах

Примечание.

Эта функция сейчас включена public preview и может измениться.

На этом этапе конфигурация создает четкую и краткую сводку. В нижней **** части параметров нажмите кнопку "Создать prompt.yml файл", чтобы открыть представление запроса. Ваш системный запрос будет автоматически заполнен.

**В поле "** Запрос пользователя" введите запрос, содержащий один или несколько заполнителей переменной в двойных фигурных скобках. Например:

Travel or shopping assistants using {{city}}, {{intent}}, and {{budget}} to tailor recommendations.

Каждая переменная, указанная в запросе, будет отображаться как параметр в режиме сравнения. При выполнении оценки вам будет предложено указать значения для каждой переменной. Это позволяет повторно использовать запросы с различными входными данными без изменения содержимого запроса.

Кроме того, можно добавить переменные в .prompt.yml файловую систему или запрос пользователя, чтобы автоматизировать процесс оценки с несколькими переменными в будущем. См. Хранение запросов в репозиториях GitHub.

Добавление тестовых входных данных

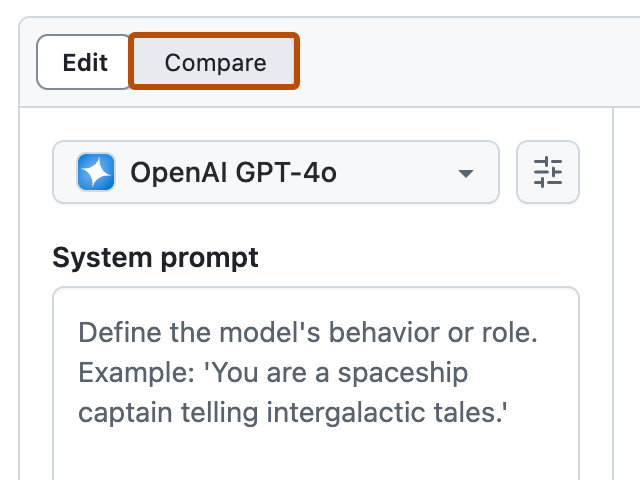

В верхней части представления "Запросы" выберите "Сравнить ", чтобы переключить представление "Сравнения". Это представление позволяет выполнять структурированные сравнения в нескольких запросах или моделях и применять вычислители для измерения производительности.

В представлении "Сравнения" каждая строка в таблице представляет один тестовый случай с определенными входными данными и ожидаемыми выходными данными. Каждый столбец представляет другую конфигурацию запроса для сравнения того, как выполняются различные модели или стили запросов с помощью оценщиков.

Нажмите кнопку "Добавить строки" , чтобы ввести тестовые данные. Входные данные имитируют реальное сообщение о поддержке, и ожидаемые выходные данные представляют идеальную сводку, которую модель должна возвращать. В приведенной ниже таблице приведены примеры входных данных теста и соответствующие ожидаемые выходные данные для оценки.

| Строка | Входные данные | Ожидаемые выходные данные | |-----|--------------------------------------------------------------------------------------------------------|-------------------------------------------------------------------------------------------------------------------------------| | 1 | Приложение завершается сбоем каждый раз, когда я пытаюсь отправить PDF-файл с моего телефона. Он работает на рабочем столе, но не на мобильных устройствах. | Пользователь сообщает, что мобильное приложение завершается сбоем при каждом попытке отправить PDF-файл, в то время как классическая версия работает без проблем. | | 2 | Я связался с поддержкой два дня назад и не слышал обратно. Мне нужна помощь по восстановлению учетной записи ASAP. | Пользователь ожидает ответа на поддержку и срочно нуждается в помощи по восстановлению учетной записи. | | 3 | Добавьте темный режим. Очень трудно использовать ночью. Мои глаза больно после длительного использования. | Пользователь запрашивает темный режим из-за напряжения глаз во время ночного использования. |

Настройка параметров модели

Справа от таблицы нажмите кнопку добавления новой конфигурации запросов.

В новой конфигурации запроса можно обновить модель и точно настроить его поведение с помощью доступных параметров. Эти параметры управляют тем, как модель создает текст, включая его длину, случайность и повторение.

Настройка модели

В раскрывающемся списке модели выберите PHI-4, чтобы создать отдельную конфигурацию для сравнения.

Вы можете настроить следующие параметры, чтобы повлиять на выходные данные модели:

-

**Максимальные маркеры: задает максимальное количество маркеров**, которые может возвращать модель. Более высокие значения позволяют выполнять более длинные выходные данные. -

**Температура**: управляет случайностью в ответе. Более низкие значения (0,2–0,4) создают более ориентированные, детерминированные выходные данные. Более высокие значения (0,8–1.0) представляют больше вариантов и творчества. -

**Top P**: управляет разнообразием выходных данных путем выбора из пула наиболее вероятных следующих слов. Более низкие значения снижают вариативность, аналогичную снижению температуры. -

**Пенальти** присутствия: не рекомендует модели вводить новые темы. Более высокие значения применяют более сильный штраф. Значение 0 обычно подходит для суммирования. -

**Частота штрафа**: снижает вероятность повторения слов. Более высокие значения применяют более сильный штраф. Значение от 0 до 0,5 помогает сохранять сводки без избыточности. -

**Остановка**. Указывает одну или несколько строк, которые при создании будут отрезаны от ответа модели. Используйте это для предотвращения чрезмерно длинных выходных данных или применения правил форматирования.

В приведенной ниже таблице приведена конфигурация параметров для создания кратких сводок во время сравнения моделей.

| Параметр | Значение | Причина |

|---|---|---|

| Максимальные маркеры | 128 | Держит ответы короткими и по теме |

| Температура | 0,3 | Обеспечивает детерминированные, ориентированные выходные данные |

| Верхний P | 1.0 | Позволяет использовать полный словарь, но сохраняет руководство по выбору |

| Штраф на наличие | 0 | Нет штрафа— сводки не нужны варианты темы |

| Частота штрафа | 0,3 | Сокращение повторяющихся выражений в компактных сводах |

| Остановить | (необязательно). | Используйте, если вы хотите завершить выходные данные после ключевого слова или символа |

После применения параметров можно добавить дополнительные столбцы для сравнения нескольких моделей или конфигураций запросов параллельно.

Оценка выходных данных

После настройки запроса выполните структурированную оценку для сравнения выходных данных модели с использованием реальных данных и повторяемых метрик.

Оценка модели помогает понять, как различные модели и конфигурации запросов выполняются в реальных входных данных. В представлении запроса вы можете применять оценщики к нескольким моделям параллельно и проверять метрики, такие как сходство, беглость, согласованность, релевантность и заземленность.

Доступны следующие вычислители:

-

**Сходство**. Измеряет, насколько близко выходные данные модели соответствуют ожидаемому или эталонному ответу. Это полезно, если вы хотите подтвердить, что модель возвращает согласованные и точные ответы, выровненные с известным результатом. Оценка диапазонов от 0 до 1 с более высокими значениями, указывающими на большее сходство. -

**Fluency**: оценивает лингвистическое качество ответа, включая грамматику, согласованность и удобочитаемость. Это приводит к лингвистически правильным ответам. -

**Согласованность**: оценивает способность LLM создавать текст, который считывает естественно, плавно и напоминает человеческий язык в своих ответах. Используйте его при оценке удобочитаемости и понятности созданных моделей ответов в реальных приложениях. -

**Релевантность**. Указывает, насколько эффективно ответ отвечает на вопрос. Она оценивает точность, полноту и прямую релевантность ответа исключительно на основе указанной информации. Оценка варьируется от 0 до 1, с более высокими значениями, указывающими на более сильное выравнивание с намерением входных данных. -

** **Основание: измеряет, насколько хорошо ответ привязан к указанному контексту, оценивая его релевантность, точность и полноту исключительно на основе этого контекста. Он оценивает степень, в которой ответ полностью решает вопрос, не вводя несвязанную или неправильную информацию. Оценка диапазонов от 0 до 1 с более высокими значениями, указывающими на более высокую точность. -

**Настраиваемый запрос**. Позволяет определить собственные критерии оценки для одного LLM для оценки выходных данных другого. Это позволяет оценить выходные данные модели на основе собственных рекомендаций. Вы можете выбрать между оценками и прохождением или сбоем, что делает его идеальным для сценариев, когда стандартные метрики не фиксируют ожидания тестирования.

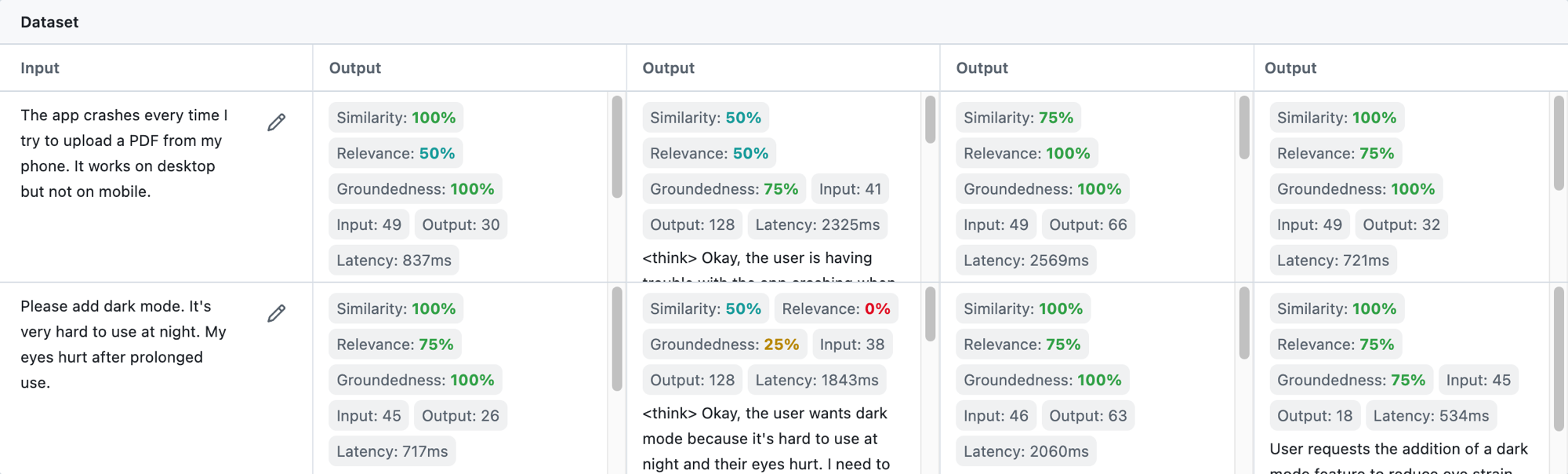

Когда вы будете готовы оценить, нажмите кнопку "Выполнить ", чтобы создать и сравнить выходные данные во всех конфигурациях запроса. После завершения GitHub Models запуска отображается результат каждой конфигурации подсказки вместе с оценочными оценками.

Тестовый случай: сбой отправки PDF

**Входные данные:**`The app crashes every time I try to upload a PDF from my phone. It works on desktop but not on mobile.`

В следующих таблицах отображаются выходные данные каждой модели и его оценки оценки:

| Модель | Выходные данные |

|---|---|

| GPT-4.1 | Пользователь сообщает, что приложение завершает работу при отправке PDF-файла с мобильного устройства, хотя отправка работает на рабочем столе. |

| DeepSeek-R1 |

<think> В порядке, у пользователя возникают проблемы с сбоем приложения при попытке отправить PDF-файл с телефона. Он работает на рабочем столе, но не на мобильном устройстве. Позвольте мне разорвать это. Во-первых, основной проблемой является сбой приложения в частности во время отправки PDF-файлов на мобильном устройстве. Тот факт, что он работает на рабочем столе, предполагает, что это проблема с мобильными устройствами. Возможные причины могут быть связаны с версией мобильного приложения, ОС телефона, ограничениями размера файлов на мобильных устройствах или проблемами совместимости с определенными форматами PDF на мобильных устройствах. Мне нужно убедиться, что сводка упоминает о сбое во время отправки PDF на мобильном устройстве, обратите внимание, что настольные компьютеры работают и |

| Phi-4 | Приложение завершается сбоем при попытке отправить PDF-файл с мобильного устройства, хотя он работает правильно в классической версии. |

| Модель | Similarity | С сортировкой по релевантности | Соответствие эталонным данным | Входные маркеры | Выходные маркеры | Задержка |

|---|---|---|---|---|---|---|

| GPT-4.1 | 100% | 50% | 100% | 61 | 20 | 918 мс |

| DeepSeek-R1 | 50% | 50% | 75% | 52 | 128 | 2285 мс |

| Phi-4 | 75% | 100% | 100% | 61 | 66 | 1117 мс |

Используйте оценки оценщика для оценки и сравнения ответов, выходящих за рамки формулировок на уровне surface.

Similarity

Оцените, насколько точно выходные данные каждой модели соответствуют ожидаемой сводке. В таблице ниже показаны оценки релевантности для каждой модели.

| Модель | Оценка сходства |

|---|---|

| GPT-4.1 | 100% |

| DeepSeek-R1 | 50% |

| Phi-4 | 75% |

Хотя все модели включали ключевое содержимое из входных данных, оценка сходства DeepSeek-R1 значительно ниже из-за подробных внутренних комментариев, которые отклоняются от ожидаемого краткого формата сводки. В отличие от этого, GPT-4.1ответ ' соответствует формулировке и структуре эталонного выхода.

С сортировкой по релевантности

Оцените, насколько хорошо каждая модель фиксирует основное намерение входных данных. В таблице ниже показаны оценки релевантности для каждой модели.

| Модель | Оценка релевантности |

|---|---|

| GPT-4.1 | 50% |

| DeepSeek-R1 | 50% |

| Phi-4 | 100% |

Все три модели распознали ключевую проблему сбоя приложения во время отправки PDF-файла на мобильном устройстве. Phi-4 получил более высокую оценку релевантности за отражение перспективы пользователя более полно. DeepSeek-R1 потерял точки для внедрения спекулятивных технических причин, не упомянутых в исходном входе.

Соответствие эталонным данным

Оцените, остается ли выходные данные каждой модели верными входным данным, не вводя неподдерживаемые сведения. В таблице ниже показаны оценки релевантности для каждой модели.

| Модель | Оценка заземления |

|---|---|

| GPT-4.1 | 100% |

| DeepSeek-R1 | 75% |

| Phi-4 | 100% |

Несмотря на то, что DeepSeek-R1 добавляет внутренний комментарий, он не вводит галлюцинированные факты. Его окончательное сводное предложение правильно отражает исходные входные данные.

Тестовый случай: запрос темного режима

**Входные данные:**`Please add dark mode. It's very hard to use at night. My eyes hurt after prolonged use.`

В следующих таблицах отображаются выходные данные каждой модели и его оценки оценки:

| Модель | Выходные данные |

|---|---|

| GPT-4.1 | Пользователь запрашивает добавление функции темного режима из-за дискомфорта и нагрузки глаз при использовании приложения в ночное время. |

| DeepSeek-R1 |

<think> Хорошо, пользователь хочет, чтобы темный режим добавил, потому что трудно использовать ночью и их глаза больно. Мне нужно сделать краткий сводные данные. Позвольте мне начать с основного запроса: добавление темного режима. Затем упоминается причина: напряжение глаз от длительного использования в ночное время. Сохраните его до одного предложения. Может быть, структурировать его как "Запрос на реализацию темного режима для снижения нагрузки глаз во время ночного использования". Это охватывает ключевые моменты без дополнительных сведений. Проверьте, находится ли это под ограничением символов. Да, выглядит хорошо. </think> Сводка. Запрос на реализацию темного режима для уменьшения нагрузки глаз, вызванной длительным использованием ночного времени. |

| Phi-4 | Клиент запрашивает добавление функции темного режима для снижения нагрузки глаз при использовании продукта в ночное время. |

| Модель | Similarity | С сортировкой по релевантности | Соответствие эталонным данным | Входные маркеры | Выходные маркеры | Задержка |

|---|---|---|---|---|---|---|

| GPT-4.1 | 100% | 75% | 100% | 57 | 18 | 1286ms |

| DeepSeek-R1 | 50% | 0% | 25% | 49 | 128 | 1946 мс |

| Phi-4 | 100% | 75% | 100% | 58 | 20 | 899ms |

Similarity

Оцените, насколько точно выходные данные каждой модели соответствуют ожидаемой сводке. В таблице ниже показаны оценки релевантности для каждой модели.

| Модель | Оценка сходства |

|---|---|

| GPT-4.1 | 100% |

| DeepSeek-R1 | 50% |

| Phi-4 | 100% |

Хотя все модели включали ключевое содержимое из входных данных, оценка сходства DeepSeek-R1 снова, значительно ниже из-за подробных внутренних комментариев.

С сортировкой по релевантности

Оцените, насколько хорошо каждая модель фиксирует основное намерение входных данных. В таблице ниже показаны оценки релевантности для каждой модели.

| Модель | Оценка релевантности |

|---|---|

| GPT-4.1 | 75% |

| DeepSeek-R1 | 0% |

| Phi-4 | 75% |

GPT-4.1 и Phi-4 отражали основную цель запроса пользователя: необходимость тёмного режима для снижения усталости глаз и улучшения удобства работы ночью. DeepSeek-R1 набрал 0 % релевантности из-за подробного внутреннего комментария, который отвлекал от фактических выходных данных.

Соответствие эталонным данным

Оцените, остается ли выходные данные каждой модели верными входным данным, не вводя неподдерживаемые сведения. В таблице ниже показаны оценки релевантности для каждой модели.

| Модель | Оценка заземления |

|---|---|

| GPT-4.1 | 100% |

| DeepSeek-R1 | 25% |

| Phi-4 | 100% |

DeepSeek-R1 набрал меньше из-за его подробного <think> блока, который включал спекулятивную причину, не присутствуют в исходном входе.

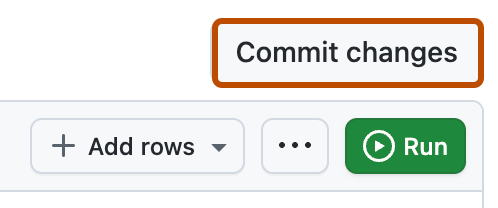

Сохранение конфигурации

После завершения оценки последний шаг — выбрать модель, которая лучше всего подходит для конкретного варианта использования. В приведённых выше примерах Phi-4 показали GPT-4.1 сильные и последовательные результаты для всех оценщиков. DeepSeek-R1 набрал меньше из-за подробной причины и менее ориентированных выходных данных.

Выбрав предпочтительную модель и конфигурацию запроса, добавьте описательное имя в файл запроса, а затем нажмите кнопку "Зафиксировать изменения". При этом модель, запрос, параметры параметров и связанный набор данных будут сохранены в качестве повторно используемых файлов конфигурации в репозитории.

Фиксация конфигурации запроса упрощает повторное использование, совместную работу и итерацию между настройками модели. Это упрощает повторное выполнение вычислений и отслеживание производительности конфигурации запроса с течением времени.

Дополнительные материалы

-

[автозаголовок](/github-models/use-github-models/storing-prompts-in-github-repositories) -

[автозаголовок](/github-models/use-github-models/integrating-ai-models-into-your-development-workflow)